story of my life

過去の蓄積を見るために書く日記.

ここ数年TOKYOに行っていない.

2025.12.27

おはようございます.ここ数年TOKYOに行っていない、最後に小旅行に行ったのが大阪に富樫展に行ったのが最後になります.来年は大阪か東京に旅行へ行きたいなと思っています. 何故、旅に行くかという問いのアンサーは非日常だから […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

Tokyo, あと, アンサー, お金, クリエイター, ここ, こと, ソメイユプロフォン, パス, みたい, メンタル, もの, リフレッシュ, 仕事, 余裕, 刺激, 創作, 問い, 大事, 大阪, 好き, 富樫, 展覧, 往復, 旅行, 日常, 明日, 最後, 来年, 東京, 毎日, 毎月, 発見, 自分, 自宅,

田舎の公共交通機関がズタボロ感.皆さん使いませんか?

2025.12.23

おはようございます.田舎の公共交通機関がズタボロ感を先日国家試験を受けに市内まで行っていた時に感じました.高知市まで行く便の運賃が以前より30円ぐらい値上げされていて愕然となりましたが、、、 これは仕方がない事だけど、や […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

JR, アクシデント, お昼, コチラ, これ, ご飯, ズタボロ, そこ, ため, ネット, パス, メリット, よう, 不便, 交通, 仕方, 以前, 使用, 値上げ, 先日, 公共, 割合, 国家, 土佐, 土日, 市内, 後免, 愕然, 明日, 時刻, 時間, 機関, 次第, 活用, 田舎, 県庁, 県民, 確か, 社会, 移動, 終了, 自分, 試験, 路線, 運賃, 過ぎ, 電車, 高知,

JavaScript(js)でcsvファイルを読み込み自動計算する(合計sum)2025年度版

2025.10.30

おはようございます.本日(2025-10-23)はぽかぽか陽気でした、そんなお昼すぎに記事を書いています、さて”JavaScript(js)でcsvファイルを読み込み自動計算する(合計sum)”がたまに読まれているので、 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

```, CSV, javascript, JS, orz, sum, いま, エラー, エレメント, お昼, コード, こと, このごろ, ズキ, ネタ, パス, ファイル, よう, 今日, 余地, 処理, 勉強, 可能, 合計, 場合, 存在, 実行, 年度, 感じ, 拡張, 改善, 文字, 明日, 本日, 来年, 汎用, 自分, 自動, 自虐, 計算, 記事, 陽気,

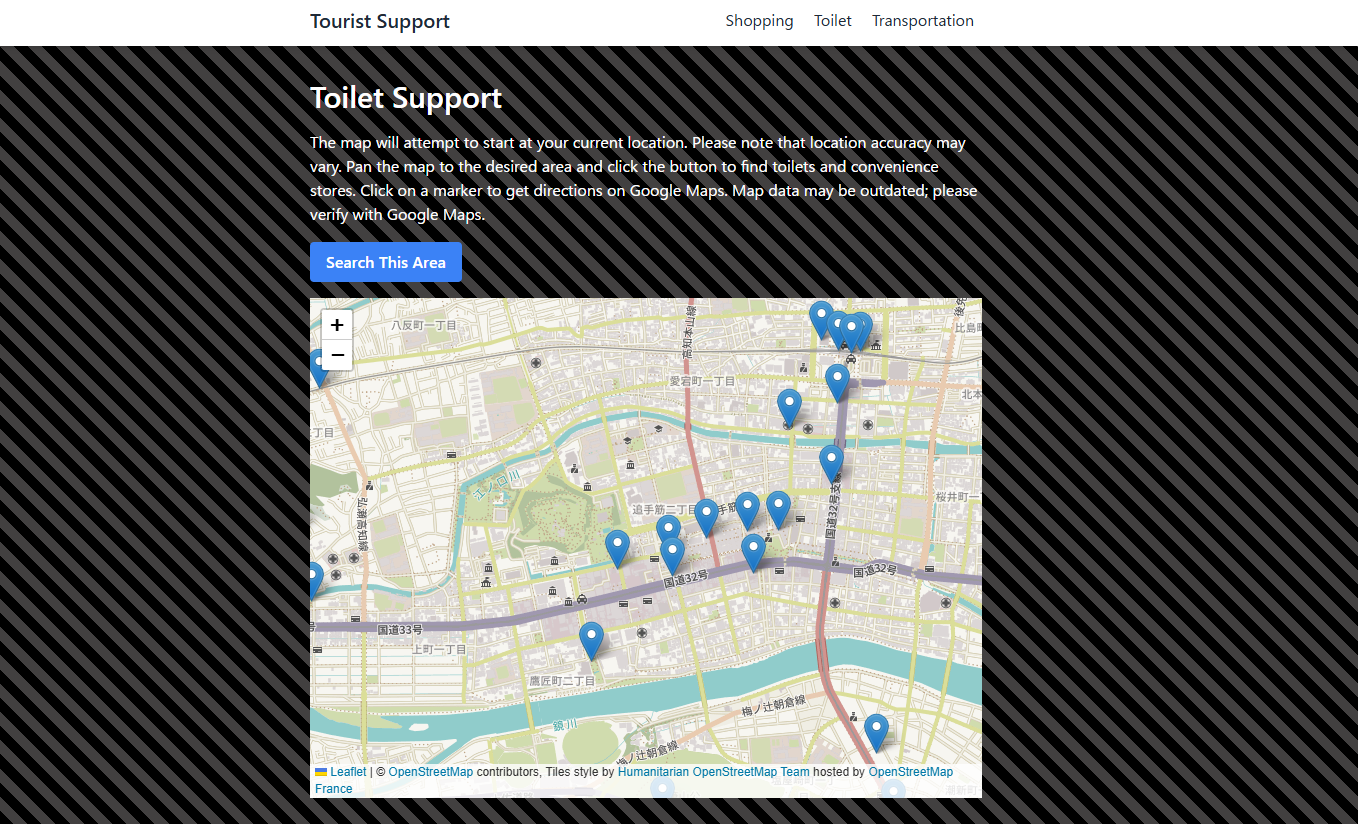

観光サポートページ(English)を追加しました.広告を貼らないで運営.

2025.10.25

おはようございます.高知県(全国)観光サポートページ(English)を追加しました.広告を貼らないで運営しています、アクセス数が増えれば広告を一つぐらい貼らしてもらうかも知れませんが今の所、広告は有りません. X(旧T […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

AI, ChatGPT, English, gemini, Twitter, アクセス, ガイド, これ, サイト, サポート, そう, トイレ, パス, ページ, ポスト, よう, リリース, レベル, 一つ, 中学生, 乗り場, 予想, 事態, 使用, 先日, 全国, 内容, 勉強, 参照, 可視, 商店, 場所, 外国, 大丈夫, 宣伝, 小学生, 市場, 平日, 広告, 感じ, 明日, 有名, 期待, 本日, 機能, 生成, 用事, 確認, 経緯, 翻訳, 自分, 英語, 観光, 記事, 評価, 調査, 追加, 運営, 過去, 高知,

こんな田舎町でも外国人の観光客ばかりになっている

2025.10.20

おはようございます.こんな田舎町でも外国人の観光客ばかりになっているという事を先日の平日に知り驚きました.先日の休みに高知県の高知市にとある用事で出かけていました. 家の近くにあるバス停からバスに乗り50分ぐらいかけて高 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

tosajininfo, アレ, ウェブサイト, おもてなし, カタコト, コチラ, こと, サービス, サイト, とき, ニュース, パス, バス停, よう, リニューアル, 下手, 人事, 休み, 先日, 光景, 告知, 商売, 商店, 地元, 外国, 大事, 大変, 平日, 待ち合わせ, 思い, 接客, 放送, 散々, 明日, 正直, 用事, 田舎町, 精神, 自分, 英語, 観光, 近く, 近日, 追加, 都会, 電車, 高知,

AIで記事を学習して新たな記事を生み出すにはお金が必要だと思っていたがそうでも.

2025.06.22

おはようございます.AIで記事を学習して新たな記事を生み出すにはお金が必要だと思っていたがそうでもなくローカルPCでそこら辺に落ちているLlamaモデルを持ってきてチューニングすれば何とかなるじゃねぇという思いに至った. […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

```, ;;), )。, アウト, アシスタント, アダプター, あたり, アップ, あなた, いくつ, ウォーム, エポック, エラー, エントリ, オープン, オプティマイザ, お金, クラウドサービス, グループ, クン, ゲーミング, コード, コア, ここ, こと, コミュニティ, コメント, これ, サイズ, サンプリング, サンプル, シーケンス, スクリプト, スケーリング, スケジューラー, スタイル, ステップ, スペック, すべて, ソース, そこら, タイプ, ダウンロード, タスク, ため, チューニング, ツール, データ, データセット, テーマ, ディレクトリ, テキスト, デバイス, デフォルト, トー, トークナイザー, とき, どれ, トレーナー, ドロップ, バイアス, パス, バッチ, パディング, パラメータ, バランス, ファイル, ファイルサイズ, ファインチューニング, ファインチューニングコード, フリーズ, プロ, プロンプト, マシン, マッピング, メモリ, モード, モデル, もの, ユーザー, よう, ライター, ライブラリ, ラベル, ランク, リモート, レベル, レポート, ローカル, ロード, ログ, 一般, 一部, 上記, 不要, 世界, 世界中, 並み, 並列, 予算, 付与, 以下, 以降, 企業, 使い, 使用, 係数, 保存, 個人, 優秀, 入力, 公開, 共有, 具体, 処理, 出力, 分割, 分散, 分野, 初期, 利点, 利用, 制御, 削減, 削除, 創造, 加速, 助け, 効率, 動作, 勾配, 十分, 参考, 反映, 可能, 向上, 味方, 因果, 場合, 多様, 夢物語, 大幅, 大量, 失敗, 学習, 完了, 完全, 完璧, 実現, 実行, 実質, 寄与, 対応, 専門, 導入, 少量, 工夫, 希望, 常識, 強力, 形式, 必要, 思い, 性能, 手元, 手法, 技術, 抜群, 指定, 指示, 挿入, 推奨, 推論, 提供, 整形, 新た, 方法, 日々, 明日, 明確, 明示, 時代, 時間, 最大, 最新, 最適, 有効, 未知数, 本格, 格段, 格納, 構築, 様々, 比率, 民主, 活用, 活発, 消費, 混合, 済み, 温度, 準備, 無効, 無料, 特定, 特権, 現実, 理由, 環境, 生成, 発生, 登場, 的確, 相性, 短時間, 確認, 秘訣, 移動, 程度, 管理, 節約, 精度, 終了, 結合, 結果, 続行, 能力, 自体, 自分, 自動的, 蓄積, 表現, 言語, 計算, 記事, 設定, 許可, 調整, 費用, 軽量, 追加, 通常, 適用, 選択, 重み, 重要, 量子, 開始, 開発, 関数, 閾値, 非常, 高速, 高額, 魅力,

投稿時間を6時から7時へシフトしました.通勤時間帯に.

2025.05.28

おはようございます.今までは6時投稿だったのだけど通勤時間帯にシフトしました、今まで6時にしていたのは、競合を避けて投稿していた感じになります.その昔まえは9時投稿にしていました.9時に投稿していた理由は仕事の関係者に記 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

アクセス数, パス, ひと, まえ, ユーザー傾向, 予約, 元, 前置き, 層, 形, 微量, 時間帯, 期待, 本題, 淡い期待, 目, 競争相手, 競合, 通勤時間帯, 電車,

GW3日目の今日の日程はこんな感じです.早朝に.

2025.05.01

おはようございます.これは予約投稿なのでこれを書いている時は子旅に行く準備をしていると思います.昨日、小旅プランのアンケートをしてみたのですが、投票0だった為、自分で決めることにしました.アンケートでは高松へ行きその周辺 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

あれ神話, アンケート, カメラ, シャツアート展, パス, プラン, 中村駅, 割高感, 土佐入野, 天候, 性能, 投票, 旅費, 晴天, 曇り空, 最後, 期間中運休, 毎度, 沈下橋, 高松,

健康診断に行くのにバスを使ってみました.とさでんマイ時刻表も.

2025.03.10

おはようございます.先日、健康診断に行くのにバスを使ってみました、そして、とさでんマイ時刻表も使ってみましたという話を書いていきます. 自分が健診にいった日はちょうど朝から雨がふりそうな予報が出ていたのだけども、バスが来 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

さでんマイ時刻表, でんマイ時刻表, パーカー, パス, バス停のりば, ブラウザ板, ヘア, もと, リアルタイム, 不審人物, 乗車, 予報, 健診, 健診どころ, 健診場所, 内心, 分遅れ, 半分, 座席, 高知県,

快適なのかわからないけど、フラットに寝れるバスを開発した高知県のバス会社.

2025.02.03

おはようございます.快適なのかわからないけど、フラットに寝れるバスを開発した高知県のバス会社.いやーこれ事故したときに悲惨な感じになりそうだなと思ってしまったのは自分がマイナス思考だからなのかな? 乗ってみたいけど […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代後半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

オープン, ガーデン, ドン・キホーテ, ドン・キホーテさん, ニュース, パス, バス会社, マイナス思考, ヤダ運行, ヨドバシ, 一部, 別話, 形, 打診, 段階, 赤字経営, 需要, 高知県, 高知県側, 魅力,

映画観てない月に.

2024.04.13

おはようございます、4月は映画観てない月になりそうです.少々物足りないなって感じつつも観ないで終わりそうな気がします.もしかしたら『4月になれば彼女は』を来週も上映されていたら観に行くかもですけど、その他、観ようかなぁっ […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

4月, GW, Photo by Johannes Plenio on Pexels.com, カテゴリ, その他, ところ, パス, 予約, 京都, 厳しい生活, 彼女, 日帰り弾丸, 映画, 月, 段階, 気, 確率, 観,

Dockerは楽だなという事を今頃理解しましたよ。 #vbox #docker

2022.10.03

おはようございます、月曜日の朝はテンション低めな方も多いはず😇。 さて、今日は先週の木曜日と金曜日にふと今後のためにDockerをもう少し触ってみようと思い作業終了後触ってみました、触れて気づいた事は開発環境を作るのがと […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

--privileged, -p, -v, 80, D-, docker, html, ID, init, IT, name, run, sbin, var, vbox, Visualbox, www, イメージ, こと, こんてな, サーバー, スムーズ, そこ, それ, ため, テンション, パス, フォルダ, マウント, 事, 人, 人間, 今後, 今日, 今頃, 低め, 作業, 先週, 共有, 可能, 周り, 命名, 得意, 方, 昔, 月曜日, 朝, 木曜日, 理解, 環境, 皆, 終了, 自分, 行, 金曜日, 開発,

ドキュメンタリー・The Future Ofをネトフリで。

2022.08.03

こんばんは、今日は昨日の夕方に書いた記事をUPします。今頃、自分は寝ているはずです…😴。 昨日のウォーキングでThe Future Of(ざ・ふぃーちゃーおぶ)のシーズン1を全話Netflixで視聴しましたので、感想を残 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

1, Future, Netflix, of, The, UP, ウォーキング, オブ, シーズン, ちゃー, ドキュメンタリー, ネトフリ, パス, ふい, もの, 一, 三, 事, 二, 今日, 今頃, 作, 全話, 其処ら, 問題, 夕方, 大人, 将来, 少し, 少年, 感想, 所, 提起, 昨日, 最初, 最終話, 未来, 犬, 現実, 科学, 自分, 視聴, 記事, 話, 辺, 青年,

インフラは動いて当たり前だからって思い込みは。

2022.07.07

おはようございます。au通信障害直りましたね。 インフラは動いて当たり前だからって思い込みは捨てないとなって今回の障害で思いました。自分のサーバはたまに落ちるのでまたサーバーが落ちただなってぐらいに思われているかもしれま […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

au, いろいろ, インフラ, きっちり, こと, サーバ, サーバー, タクシー, たま, パス, もの, 一, 中, 今回, 代表, 何分, 其れ, 其れぐらい, 具合, 反面, 国, 対応策, 当たり前, 心, 方, 日本, 時, 時間, 有事, 本当, 欠如, 正確, 気, 精神, 自分, 通信, 遅延, 障害, 電車,

素晴らしいコードに出会うという事はとても大事ですよね。夜も眠れません😏

2022.03.22

おはよう御座います。素晴らしい世界を聴きながら。 プログラマーにとって技術力を上げるのは多分、向上心があるからだと思います。 さてプログラミングをするにあたって素晴らしいコードに出会うという事はとても大事です。素晴らしい […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

8, com, github, https, TWo, vwLaT-, watch, www, youtube, コード, これ, シンプル, パス, フォロー, プログラマー, プログラミング, 上達, 世界, 事, 何, 向上心, 夜, 大事, 彼ら, 彼女, 思考, 技術, 技術力, 方法, 最初, 無駄, 理解, 自分, 身,

WindowsやMACのタイピングを表示するアプリと検索すれば!?

2022.01.18

この頃、気温が若干低いなという感覚があります、昨日なんて寒くてウォーキングを諦めました😌。 さてWindowsやMacのタイピングを表示するアプリと検索すれば、それなりのアプリが出てきますのでそちらを使用してみてください […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

altapps, github, https, ja, KeyCastr, Mac, net, soft, Windows, あと, アプリ, インストール, ウォーキング, キー, キーボード, キーワード, こちら, ストローク, そちら, その他, それなり, ターミナル, ダイビング, パス, フリー, メモ, リンク, ログ, 上記, 人, 使用, 公開, 参照, 場合, 存在, 感覚, 操作, 昨日, 有名, 検索, 気温, 自分, 若干, 表示, 頃,

.jpg)

ネット常識力は神レベルでもない。知らないことのほうが多いかも?

2021.10.11

今日は雨が降っています。高知県は結構な雨ですね…。自分は雨音が好きなので全然良いですけど雨が嫌いな人にとっては憂鬱な一週間になるかもしれませんね。 さて、昨日と今日はお国の偉い人が決めたデジタルの日です。Yahoo!でも […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

10, 15, 31, ANA, IT, Yahoo, エンジニア, グランド, こと, スタッフ, デジタル, テスト, ネット, パス, プロフェッショナル, みんな, レベル, 一, 一般人, 事, 人, 今, 今日, 先日, 全問, 全国, 問題, 回, 国, 女, 嫌い, 常識, 彼女, 憂鬱, 新人, 日, 昨日, 時, 最下位, 模試, 正解, 研修, 神, 称号, 簡単, 結構, 統一, 自分, 試験, 逆, 道のり, 開催, 雨, 雨音, 駆け出し, 高知県,

Notionというアプリが定着しているけどどうなのかな。

2021.08.15

雨はシトシトと降っている、平日に土日の記事を予約投稿しています?。 非ITエンジニアの方はあまり知らない、もしくは、はじめて聞いたという方もいると思いますがITエンジニアの方々にはNotionというアプリが結構、定着して […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

IT, Notion, youtube, アプリ, エンジニア, こと, それ, ため, データ, データベース, どこか, パス, まだこ, メモ, わけ, 予約, 人, 今回, 使い方, 使用, 動画, 名前, 土日, 定着, 平岡, 平日, 情報, 所, 投稿, 整理, 方, 方々, 枠, 無料, 理由, 界隈, 皆さま, 神, 管理, 簡単, 自分, 視聴, 記事, 説明, 雄太, 雨, 非,

算数問題が100問ランダムで生成されます。そんなツールを作りました。

2021.08.08

暑い日が続いています、このまま茹でダコにでもなってしまいそうな部屋の温度ですが・・・エアコンは殆どOFFで日中を過ごして夕方から夜中まで稼働させております。そんな日を過ごしていて、たまに外へ出かけると夏休みなのか、学生さ […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

100, off, あれ, エアコン, こと, このまま, これ, スパルタ, たま, ツール, ドラゴン, パス, びっくり, ミス, ランダム, 中, 中々, 事, 事実, 単純, 問題, 基礎, 夏休み, 夕方, 外, 夜中, 学生, 実感, 少し, 教師, 数学, 日, 日々, 日中, 暗算, 本当, 桜, 殆ど, 温度, 満点, 生成, 稼働, 算数, 簡単, 自分, 自転車, 茹でダコ, 計算, 足し算, 部屋,

ファイナルファンタジー7リメイクが発売して結構月日が経ちますが。

2021.06.15

ファイナルファンタジー7リメイクが発売して結構月日が経ちますが未だにPART1をクリアしておりません、いまエピーソード14のクエストをちょびちょびと解決していってます。まだPART1もクリアしていないので6月10日にリリ […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

1, 10, 14, 5, 6, 7, FANTASY, FINAL, INTERGRADE, Part, PlayStation, PS, REMAKE, SONY, VII, いま, インター, エピーソード, クエスト, クリア, グレード, スクエアエニックス, ところ, パス, ファイナルファンタジー, ペイ, リメイク, リリース, 品不足, 多分, 契約, 月日, 未だ, 業者, 楽天, 正直, 民, 発売, 結, 解決, 販売, 赤字, 転売, 高価, 高値,

TensorFlow Lite(テンソルフロー ライト)をインストールしモデル実行まで。

2021.06.14

ラズベリーパイ3にTensorFlow Lite(テンソルフロー ライト)をインストールしモデル実行まで軽く字幕で紹介した動画が下記になります。インストール方法は公式に書かれた通りに実行すれば上手くインストール出来るはず […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

3, image, label, LITE, py, tensorflow, あなた, インストール, エラー, コード, ここ, コマンド, スペック, ソース, それ, テンソル, はい, パス, パラメーター, フロー, ブログ, マシン, マスター, モデル, ライド, ラズベリー, 下記, 事, 修正, 公式, 出力, 動画, 原因, 問題, 場合, 字幕, 実行, 方法, 箇所, 紹介, 結論, 自分, 解説, 通り,

SEOって意味があるのかわからないけれどAll in One SEOの採点は気にしてる。

2021.05.14

SEOって意味があるのかわからないけれどAll in One SEOの採点は気にしてる自分。ワードプレス(WordPress:WP)にはオールインワンSEO(エスイオー)というプラグインがあり、最新版には記事単位でSEO […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

70, 80, all, in, one, SEO, WordPress, wp, エスイ, オー, オールインワン, コード, こと, スコア, データ, パス, ヒント, フォーム, プラグイン, プレス, ワード, 下, 中身, 処理, 単位, 基準, 大体, 導入, 得点, 意味, 投稿, 採点, 提供, 方, 最低, 最新版, 機能, 気, 無料, 自分, 記事, 記載, 送信, 頃,

FF14を自動起動させてパスワード入力を

2021.03.23

Power Automate Desktop使用してFF14を自動起動させてパスワード入力する事を試みる。パスワード入力の動作を録画して再現して実行してみると動かないので自分で直しました。当初はUI Pathを活用して試 […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

14, Automate, Desktop, FF, path, PC, Power, UI, アプリ, ウェイト, キー, こと, これ, ご自身, テキスト, パス, パスワ, パスワード, フリー, プレイ, フロー, ワン, 上記, 下記, 事, 他, 使用, 保存, 入力, 再現, 再生, 動作, 単純, 実行, 当初, 待ち時間, 後, 必要, 方, 方法, 最中, 活用, 自分, 自動, 設定, 調整, 起動, 送信, 部分, 録画,

現役エンジニアならFizzBuzz問題なんて余裕なのか検証してみたをやってみた?

2021.03.22

【現役エンジニアならFizzBuzz問題なんて余裕なのか検証してみたをやってみた】、この道、10年選手の自分が解いてみた結果、2つの解になることになりました。でも自分はかなり緊張するタイプなのでこういう場ではなんかミスり […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

1, 10, 15, 2, 3, 5, ary, check, FizzBuzz, function, hog, hoge, if, lt, php, STR, エンジニア, かなり, コード, こと, これ, ダイビング, タイプ, ところ, パス, ミス, りそう, 上, 余裕, 倍数, 問題, 場, 日本人, 時, 検証, 現役, 理由, 疑問, 皆, 結果, 緊張, 自分, 衝突, 解, 誰か, 道, 選手,

もう3日目ですね。

2021.01.03

もう正月も3日目になってしまいました。休みってなんて早いだろうか。ただの寝正月になってしまった人は結構いるはずです。何せ、コロナですから…。東京では外出自粛になっている事もあり巣篭もりお正月を迎えたり、お一人様のお正月だ […]

![]() 著者名

@taoka_toshiaki

著者名

@taoka_toshiaki

※この記事は著者が40代前半に書いたものです.

Profile

高知県在住の@taoka_toshiakiです、記事を読んで頂きありがとうございます.

数十年前から息を吸うように日々記事を書いてます.たまに休んだりする日もありますがほぼ毎日投稿を心掛けています😅.

SNSも使っています、フォロー、いいね、シェア宜しくお願い致します🙇.

SNS::@taoka_toshiaki

タグ

3, お正月, こと, ころ, コロナ, ストレス, だだ, ところ, パス, ひとり, ポッチ, わけ, 一人, 事, 人, 友人, 外出, 学生, 寝正月, 感じ, 日々, 日常, 映画館, 時代, 来年, 東京, 正月, 正直, 殆ど, 気, 生活, 知人, 禍, 終息, 自分, 自粛, 苦, 足,